Lessons from Building Claude Code:怎么把 Skills 真正做成生产力

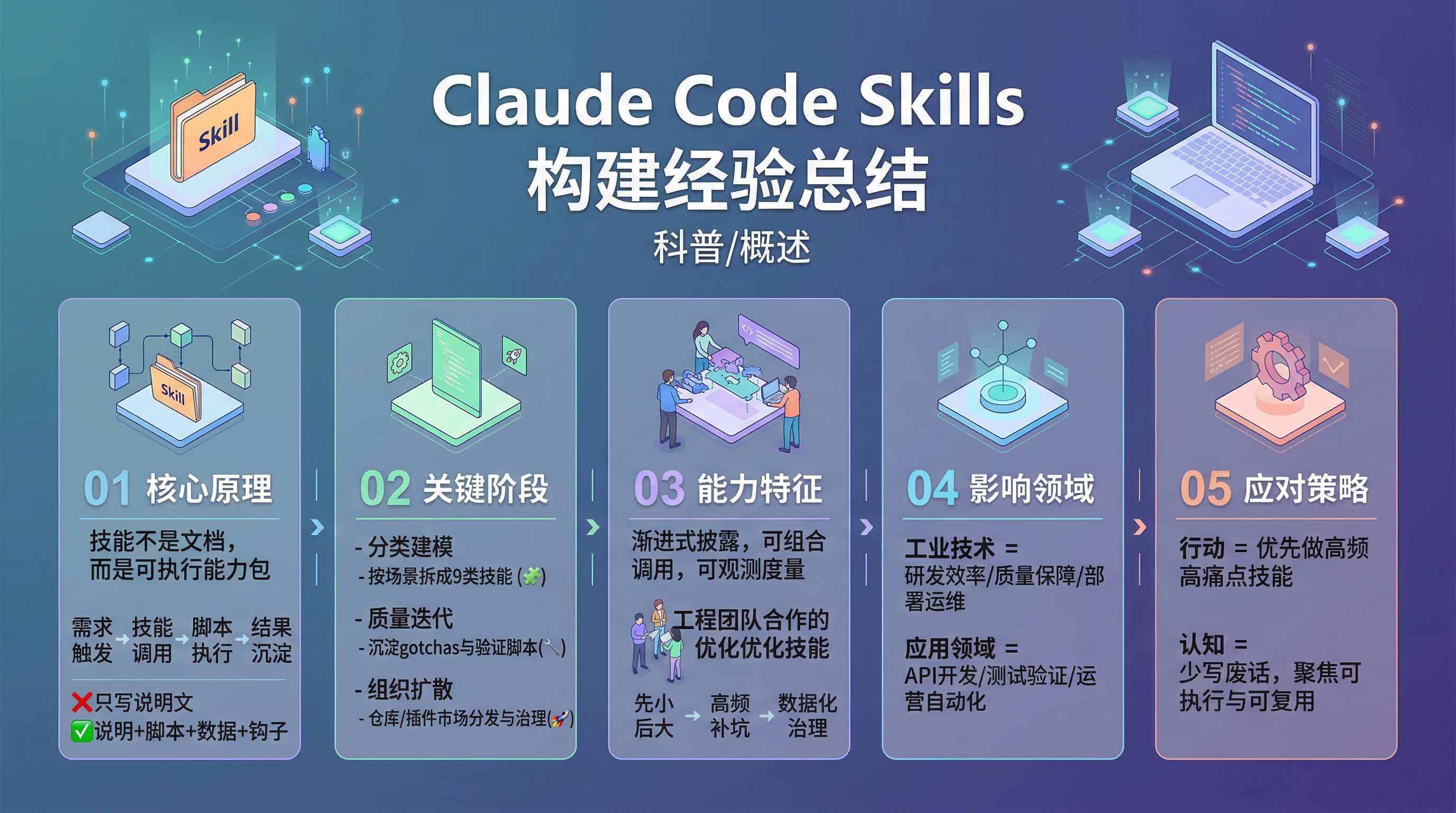

发布日期:2026-03-18一句话总结:这篇文章最有价值的观点是:Skill 不是“给模型看的说明书”,而是“可执行的能力封装单元”。真正高价值的 Skill 必须同时解决三件事——触发准确、执行稳定、持续进化。

一、文章核心观点(中文精要)

Anthropic 团队在内部已经高频使用了数百个 Skills,结论很直接:Skills 的上限非常高,但下限也很低。它“好做、好分发”的优势,反过来会带来一个现实问题——团队很容易做出大量重复、模糊、低触发率、低可靠性的技能,最终造成管理成本上升。文章最重要的贡献,不是再讲“Skill 可以做什么”,而是给出了一个更实战的框架:先明确技能类型,再围绕“可执行性”构建资源,再用度量机制持续优化。

作者特别强调一个常见误区:很多人把 Skill 当成 markdown 指南,结果写了很多“正确废话”。而在 Claude Code 体系里,Skill 实际上是一个目录结构,可以包含脚本、模板、引用文档、历史日志、配置文件,甚至按需激活的 hooks。也就是说,Skill 最强的地方是“组合能力”——把知识、工具、流程和约束放进同一个可复用单元,让模型从“临场发挥”变成“按最佳实践执行”。

二、9 类 Skills 的价值地图(为什么这个分类有用)

文章把内部技能归纳为 9 类:API/库参考、产品验证、数据分析、业务流程自动化、代码脚手架、代码质量审查、CI/CD 发布、故障 Runbook、基础设施运维。这个分类很实用,因为它对应的不是“知识主题”,而是“组织真实工作流”。比如你做验证类 Skill,就要强依赖 Playwright、tmux、断言脚本;做业务流程类 Skill,就要关注输入模板和状态沉淀;做运维类 Skill,就要加明确的安全护栏。分类一旦清楚,Skill 的边界就清楚,触发条件和维护责任也更清楚。

三、最值得抄作业的 7 条实践

1)别写常识,写反常识。 模型本来就知道基础 coding 规则,Skill 应该只写“组织特有信息”和“高频踩坑”。

2)Gotchas 是信号密度最高的部分。 真正有用的技能,不是写得漂亮,而是把历史事故和失败模式持续沉淀进去。

3)把文件系统当上下文工程。 主文档保持精简,复杂细节放 references/,可执行动作放 scripts/,输出样式放 assets/,按需加载,避免上下文膨胀。

4)不要把模型“轨道化”得太死。 指令要有约束,但也要给场景适配空间。过度僵化会让模型在异常场景下失效。

5)提前设计 setup 机制。 例如 channel、dashboard ID、业务枚举值,不应硬编码在主流程里,最好配置化。

6)description 不是简介,是触发条件。 描述字段是模型“检索技能”的索引入口,写不好会直接导致技能漏触发。

7)做技能就做度量。 用 hook 统计调用率、成功率、补救率,才能判断是“技能无用”还是“触发不准”。

四、分发与治理:从个人提效到组织能力

文章对“怎么推广 Skill”给了务实建议:小团队可以先放仓库内;规模上来后,最好走插件市场并做最小治理。因为 Skill 增长太快时,最大的风险不是“没人用”,而是“到处有类似技能,标准冲突,维护失控”。他们采用的做法是先让技能在小范围自然验证,再推动进入正式市场。这个思路很对:技能治理不该先做重流程,而是先做结果导向,靠真实使用反馈筛选有生命力的技能。

五、我的判断:这篇文章真正讲的是“工程化心态”

如果只看表面,这是一篇讲 Claude Code Skill 写作技巧的文章;但实质上,它讲的是“如何把 AI 助手从聊天工具变成工程系统的一部分”。关键不是你有多少 Skill,而是每个 Skill 是否具备可验证的交付价值:是否减少重复劳动、是否降低错误率、是否缩短从需求到上线的路径。凡是不能回答这三个问题的 Skill,基本都是“看起来很忙”的装饰品。

对团队来说,最该做的不是一上来建 100 个技能,而是先做 5~10 个“高频高痛点”技能,把触发、脚本、模板、度量闭环打通。只要这些核心技能跑顺了,后续扩张会很快;反之,如果一开始就堆数量,后面一定会进入维护地狱。文章给出的经验非常接地气:Skill 的成长路径通常是“几行说明 + 一个 gotcha”起步,然后在真实使用中持续迭代,这比“闭门造车写大全”靠谱太多。

六、可直接执行的落地清单

| 动作 | 建议做法 | 预期收益 |

|---|---|---|

| 技能盘点 | 按 9 类重新归档,删除重叠技能 | 减少冲突与维护成本 |

| 补 gotchas | 每次失败后追加“触发条件+修复策略” | 显著提高成功率 |

| 脚本化关键动作 | 把稳定步骤放入 scripts/,避免重复生成 | 提速并降低随机错误 |

| 加调用度量 | 记录调用频次、成功率、回滚率 | 知道该优化哪一个技能 |

| 分发机制 | 先小范围试用,再进入正式市场 | 保证质量,避免技能泛滥 |